最近,英伟达推出了大型语言模型Nemotron-4 15B,以其卓越性能和创新架构引起广泛关注。该模型拥有150亿参数,在8T token上完成了训练,目标是打造一个能在单个A100/H100可跑的通用大模型。

Nemotron-4 15B采用了标准的Transformer架构,包括多头自注意力机制和前馈神经网络。其独特之处在于,Nemotron-415B结合了自注意力和全局注意力机制,以更好地理解输入序列内部的依赖关系和输入序列与输出序列之间的对应关系。多头注意力的引入进一步提高了模型的表达能力和泛化能力。

Transformer由多个相同的层组成,每个层都有多头自注意力机制和前馈神经网络。自注意力机制使模型能够在输入序列中捕捉到不同位置之间的依赖关系,以及输入序列中各个位置之间的关联性。前馈神经网络则通过多层感知机,对每个位置的表示进行非线性变换。

1、解码器

Nemotron-4 15B只使用了Transformer的部分解码器。解码器主要负责将输入序列转换为输出序列,通过自注意力机制和前馈神经网络对输入序列进行处理。

2、注意力机制

在Nemotron-4 15B中,注意力机制被用于自注意力和全局注意力。自注意力用于学习输入序列内部的依赖关系,而全局注意力用于学习输入序列与输出序列之间的对应关系。通过注意力机制,模型能够聚焦于输入序列中与当前位置相关的信息,从而更好地理解上下文。

3、多头注意力

在Nemotron-4 15B中,每个注意力机制都有多个注意力头,每个头都可以学习到不同的关注信息。通过使用多头注意力,模型能够同时关注输入序列中的不同方面,从而提高了模型的表达能力和泛化能力。

4、位置编码

位置编码是一种用于为输入序列中的每个位置添加位置信息的技术。Nemotron-4 15B使用了旋转位置编码,使模型能够在处理输入序列时考虑到位置信息,从而更好地捕捉到序列中的顺序关系。

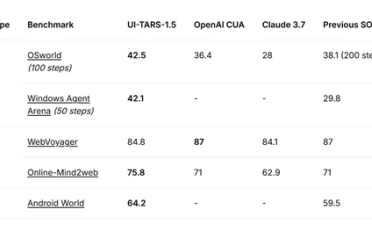

在多领域测试中,Nemotron-4 15B在7个领域中的4个表现优异,超越了同类大小的开源模型。特别值得注意的是,在代码语言方面,Nemotron-4 15B展现出更高的准确率,尤其在资源稀缺的编程语言上超过了Starcoder和Mistral7B等模型。