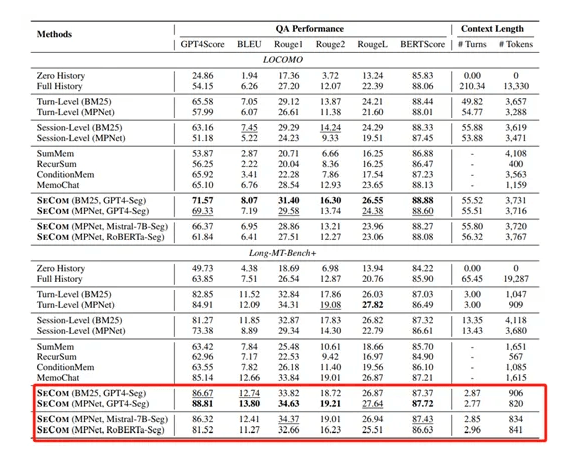

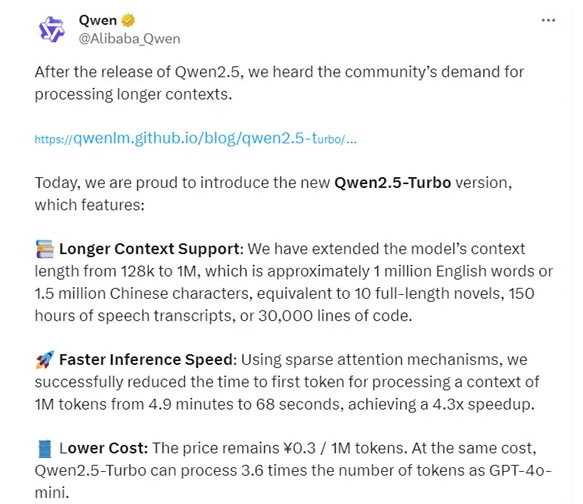

最近阿里重磅推出开源AI模型Qwen2.5-Turbo,支持100万超长上下文,相当于100万个英文单词或150万个汉字,在多个长文本评测集上的性能表现超越GPT-4。

目前所有用户都可以在阿里云百炼调用Qwen2.5-Turbo API,价格仅为0.3元/1M tokens。以下是Qwen2.5-Turbo的一些优势特色:

1、支持100万Tokens上下文

Qwen2.5-Turbo支持100万Tokens上下文,使其在处理复杂长文本任务时表现出色。

2、采用稀疏注意力机制

Qwen2.5-Turbo通过采用稀疏注意力机制显著提高了推理速度,将生成首个token的时间从4.9分钟减少到了68秒,实现了4.3倍的加速,也就是说在实际应用中,能更快地响应用户的请求。

3、价格便宜

尽管Qwen2.5-Turbo的处理能力大幅提升,价格却保持不变,为0.3元/1M tokens,用户可以以相同的成本处理更多的tokens,即3.6倍于GPT-4o-mini的tokens数量。

据悉,Qwen2.5-Turbo在短文本基准测试中的大多数任务上显著超越了之前上下文长度为1M tokens的开源模型,并且与GPT-4o-mini和Qwen2.5-14B-Instruct模型相比,在短文本任务性能接近的同时,支持8倍长度的上下文。

现阶段,Qwen2.5-Turbo主要通过API来使用,方式、标准和Qwen API相同,并兼容OpenAI的API。

通过API来使用Qwen2.5-Turbo教程:

1、首先用户需要在阿里云大模型服务平台注册并获取API Key。这个密钥是调用Qwen 2.5 Turbo API所必需的认证信息。

2、如果打算在Python环境中使用Qwen 2.5 Turbo,需要先安装OpenAI库。可以通过运行pip install openai命令来完成安装。

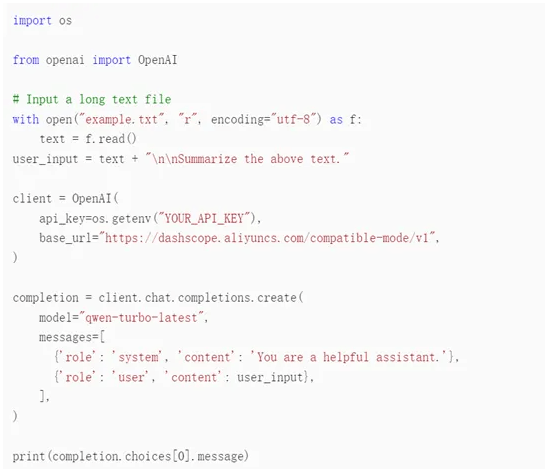

3、读取一个包含长文本的文件,然后请求Qwen 2.5 Turbo对该文本进行总结。

4、当上述代码执行完毕后,completion.choices[0].message.content将包含Qwen 2.5 Turbo生成的文本摘要。