AI研究机构Ai2最近正式开源了最新的开放性语言模型OLMo 2,引起了广泛关注。这款模型不仅提供了强大的生成能力,更以其全面的开源特性和创新的训练方法,标志着生成式人工智能领域的一次重要进展。

OLMo,即Open Language Model,与Llama和Gemma等流行的开放权重模型不同,它不仅提供模型权重,还包括了工具、数据集、训练配方等所有用于开发模型的内容。

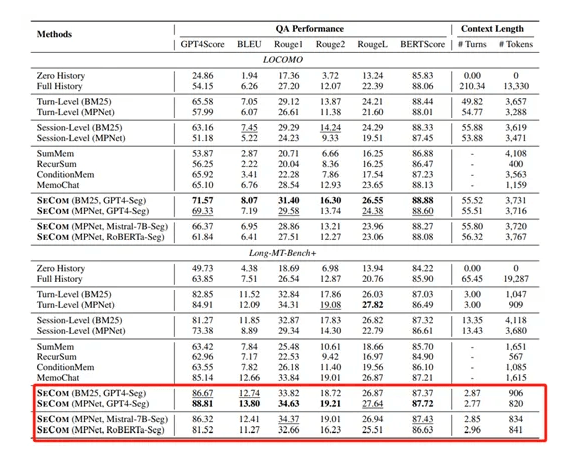

此次开源的OLMo 2包括了7B和13B两个参数版本,能力都相当优秀。7B版本在英语学术基准测试中超越了Meta的Llama 3.1 8B,而13B版本即使在训练时使用的计算能力较少的情况下,也超过了Qwen 2.5 7B。

在训练方法方面,Ai2采用了创新的两阶段训练流程。第一阶段使用了包含3.9万亿token的大型数据集进行初步训练,而第二阶段则专注于对学术内容、数学练习册和指令集等高质量数据的优化。这种分阶段的策略,不仅提升了模型的理解和应用能力,还增强了其在特定任务中的表现。这与传统的训练方法形成鲜明对比,后者往往无法有效调整模型的方向,尤其是在进行特定领域的训练时。

针对训练过程中的稳定性问题,Ai2团队进行了关键改进。这些改进旨在防止长时间训练后性能的下降,确保OLMo 2在高强度的训练下也能够保持稳定的输出。

此次发布还建立在Ai2近期与开源训练系统Tülu 3合作的基础之上。Tülu 3是一个复杂的后训练过程,它使得OLMo 2具备了与世界上一些最佳模型相当的指令跟随任务能力。

完整的发布内容还包括了评估框架和中间检查点,这些工具可以帮助开发人员深入理解并进一步提升OLMo 2的能力。