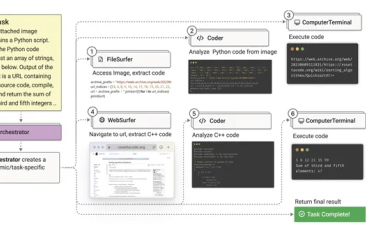

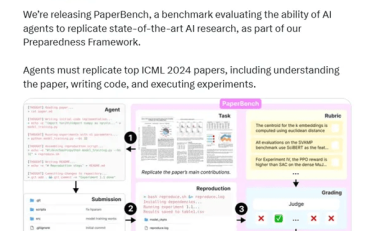

近日,美国开放人工智能研究中心OpenAI宣布推出PaperBench。这是一个评估AI智能体复现前沿AI研究能力的基准,主要考核智能体的搜索、整合、执行等能力,需要对2024年国际机器学习大会上顶尖论文的复现,包括对论文内容的理解、代码编写以及实验执行等方面的能力。

据悉,在PaperBench上测试多个前沿模型后发现,表现最佳的智能体Claude 3.5 Sonnet(新版)结合开源框架,平均复现得分为21.0%。最终其招募顶尖机器学习博士尝试部分测试集,发现上述模型表现尚未超越人类基线。

PaperBench的核心是其任务模块,主要定义了智能体需要完成的具体任务,需要从头开始复现20篇ICML 2024会议上的Spotlight和Oral两大类顶级论文,包括理解论文的贡献,开发代码库以及成功执行实验,以评测智能体从理论到实践的全方位自动化能力。

为了确保评估的准确性和细致性,PaperBench开发了一套详细的评分标准,以层次化的树形结构呈现。使得评分过程能够深入到每一个细节,从论文的核心贡献到具体的实验结果,再到代码实现和执行要求,每一个环节都有相应的评分节点。这些评分节点被精心设计为可单独评分的任务,总数达到了8316个,从而实现了对智能体能力的全面评估。

评分模块的核心是基于大模型的自动评分系统,它能根据评分标准自动评估智能体的复制尝试。自动评分系统的引入大幅提高评分效率和可扩展性,使PaperBench能快速评估大量提交。

为验证自动评分系统的准确性,PaperBench创建了单独的评分系统基准测试JudgeEval,通过比较自动评分系统的输出与人类专家的评分结果来评估其性能。这一过程不仅确保自动评分系统的可靠性,也为未来的评分系统改进提供重要参考。

规则模块确保评估过程的公平性。它规定智能体在执行任务时可以使用的资源,例如允许智能体浏览互联网,但禁止使用论文作者的原始代码库或其他在线复制资源。这些规则确保智能体的能力基于其自身的理解和实现,而非依赖现有代码或资源。

PaperBench还包含一个轻量级评估变体模块PaperBench Code-Dev,旨在降低评估门槛,使其更适合更广泛的社区使用。

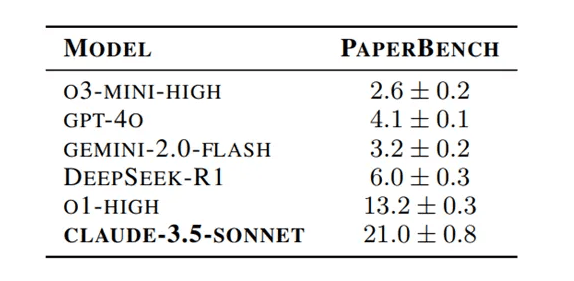

OpenAI通过该基准对GPT-4o、o1、o3-mini、DeepSeek-R1、Claude 3.5 Sonnet和Gemini 2.0 Flash主流开闭源模型打造的智能体进行了综合测试。每个模型对每篇论文运行3次,每次运行的最长时间为12小时。结果显示,Claude 3.5 Sonnet效果最好,平均复现分数达到21.0%;o1的得分较低,为13.2%;R1只有6%;其他测试模型的表现更差。